Todos hablan de optimización para LLMs. Pocos se preguntan si los sitios siquiera cargan.

Este caso no parte de una hipótesis sofisticada, sino de algo mucho más básico: qué pasa cuando una IA responde a una búsqueda real y consulta sitios… que no cargan. Lo que sigue es un diagnóstico incómodo.

Esto no es SEO. No hay auditores. No hay hojas de cálculo. Hay una pregunta simple y un agente de IA con navegación real, actuando como lo haría cualquier usuario en 2025: buscando en Google y entrando a los sitios que aparecen.

La keyword no fue elegida por volumen ni por estrategia. Fue necesidad pura: encontrar un dron para vigilar una casa. Lo demás fue observar qué sitios logran, al menos, existir en el momento más crucial: cuando la IA intenta leerte.

No era una auditoría. Era una búsqueda.

Y la mitad de los sitios fracasó en el primer paso: existir.

No estaba haciendo una auditoría SEO. No estaba probando un crawler, ni optimizando una arquitectura, ni comparando la cobertura de indexación. Estaba, simplemente, haciendo una búsqueda. Una búsqueda real. Una necesidad cotidiana: encontrar un dron para vigilar los alrededores de mi casa (vivo en el medio de la selva).

Pero no la hice yo directamente. Le pedí al nuevo agente personalizado de ChatGPT (uno de esos que pueden navegar la web como un usuario real) que hiciera la tarea por mí. Que investigara, que leyera, que entrara a los sitios.

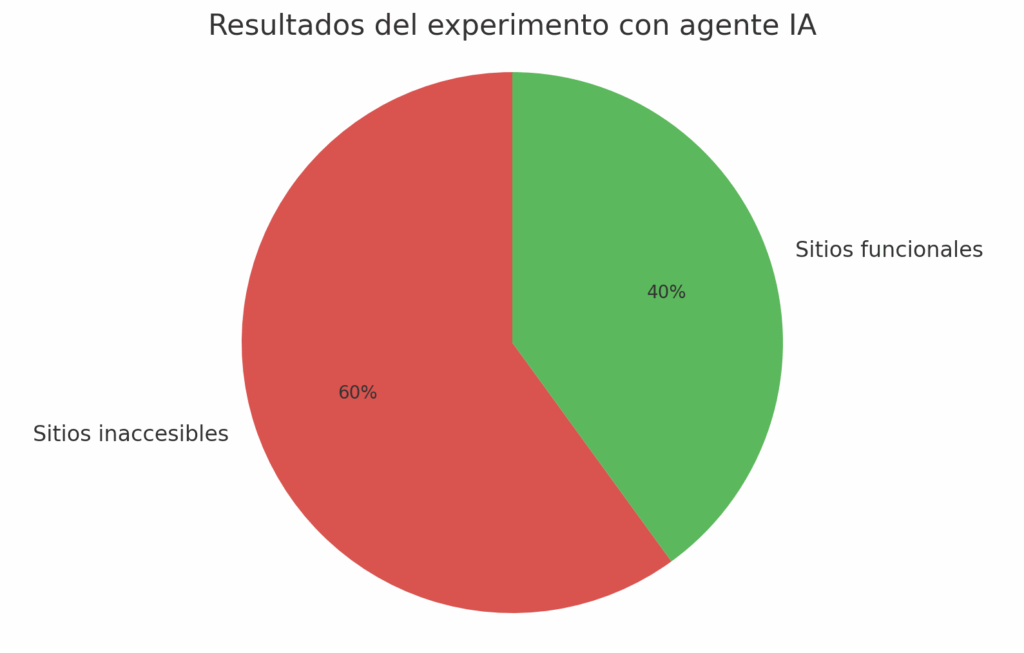

Se analizaron los sitios que el agente visitó tras realizar la consulta, sin intervención humana ni sugerencias.

Diez en total.

Seis de ellos (por distintos motivos técnicos) no lograron cargarse o impidieron que el agente accediera a su contenido.

El resultado fue un desastre técnico disfrazado de SERP. Más de la mitad de los sitios web a los que el agente intentó ingresar fallaron de formas escandalosamente básicas:

- No cargaron.

- Bloquearon el acceso.

- Mostraron errores de renderizado.

- Activaron protecciones automatizadas.

- Se negaron a entregar contenido útil.

No eran sitios mal posicionados. Todo lo contrario: eran los primeros resultados de Google. Eran, teóricamente, los ganadores.

Pero no pudieron ni siquiera abrir la puerta.

Sitios bien posicionados que no supieron entregarse

No se trataba de páginas perdidas en la página 12. Todos estos sitios estaban bien colocados en la SERP. Algunos eran tiendas, otros artículos de blog, otros comparadores o marketplaces. Todos, en teoría, habían hecho lo necesario para estar ahí arriba. Pero lo que descubrí fue una patología estructural del ecosistema digital: el SEO técnico ya no se rompe por negligencia, sino por sobreingeniería inútil.

Entre los errores más comunes que impidieron el acceso del agente se encontraron:

- Intersticiales de seguridad (tipo Cloudflare) que requieren validación humana para continuar.

- Sitios SPA (Single Page Applications) que no devuelven contenido HTML útil en el primer request.

- Cargas asincrónicas que nunca se completan si no hay interacción.

- Bloqueos automáticos por reglas anti-bots o WAF mal configurados.

- Redirecciones forzadas según IP sin opción de fallback.

- Contenido encapsulado tras capas de cookies, consentimientos y scripts que nadie ejecuta.

En otras palabras: el contenido estaba ahí, pero inaccesible. Y si no puede ser accedido, no puede ser leído. Y si no puede ser leído, no puede ser usado.

La paradoja es brutal: estos sitios ganaron el primer round del SEO (el ranking), pero perdieron el que realmente importa en la era de los modelos generativos (la legibilidad estructural). Estaban presentes, pero no disponibles. Indexados, pero no útiles. Prometían información, pero no podían entregarla.

Caso de estudio

Contexto de investigación:

Durante una búsqueda real orientada a encontrar un dron para vigilancia residencial, se utilizó un agente personalizado de ChatGPT con capacidad de navegación web. El objetivo era simular el comportamiento de un usuario que accede a los sitios mostrados en la primera página de resultados de Google (SERP) y evaluar cuántos sitios pueden ser realmente accedidos, cargados y leídos por un sistema basado en IA.

Motivación:

Con la creciente importancia de los modelos de lenguaje (LLMs) como filtros de visibilidad, surge una nueva exigencia: los sitios deben no solo posicionarse, sino también ser técnicamente legibles para los sistemas automatizados que ahora median la consulta. Este experimento buscó contrastar esa exigencia con la realidad técnica de los sitios mejor posicionados.

Metodología

- Agente utilizado: ChatGPT con navegación activada y seguimiento paso a paso de clics, navegación y accesos.

- Consulta: “Drone para vigilar mi casa”.

- Análisis: Se evaluaron los primeros 10 enlaces orgánicos arrojados por la búsqueda (SERP principal).

- Criterio de fallo: Se consideró error cualquier situación que impidiera el acceso fluido al contenido, incluyendo bloqueos, errores de carga, validaciones humanas, bloqueos por IP o diseño incompatible con navegación automatizada.

- Condición controlada: No se introdujeron interacciones humanas. El agente actuó como lector pasivo, tal como lo haría un crawler o un modelo de lenguaje en fase de entrenamiento o consulta.

| Total de sitios evaluados | Sitios con errores de acceso o lectura | Sitios accesibles correctamente |

|---|---|---|

| 10 | 6 | 4 |

Porcentaje de error:

60% de los sitios presentaron fallos que impidieron el acceso correcto al contenido.

Principales errores detectados:

- Protección Cloudflare activada (validación humana requerida)

- Carga asincrónica infinita sin fallback

- Redirecciones basadas en IP sin contenido alternativo

- Bloqueo por WAF a IPs de navegación automatizada

- Estructura SPA sin prerendering

| Sitio (anonimizado) | Problema detectado | Consecuencia para el agente |

| Sitio 1 | Error de renderizado JS | No se cargó ningún contenido |

| Sitio 2 | WAF bloqueó acceso | Se devolvió error 403 |

| Sitio 3 | Página requiere clic manual | Contenido no visible |

| Sitio 4 | Carga parcial del DOM | Información incompleta |

| Sitio 5 | Consentimiento no otorgado | Contenido bloqueado |

| Sitio 6 | Timeout al acceder | No hubo respuesta |

Aunque los sitios estaban bien posicionados en Google, la mayoría no fue capaz de entregar su contenido ante un lector automatizado. Esto sugiere que su visibilidad en motores de búsqueda tradicionales no garantiza su visibilidad ni su citabilidad en entornos LLM. En consecuencia:

- No pueden ser citados por modelos de lenguaje.

- No son útiles para asistentes inteligentes.

- No participan del nuevo ecosistema semántico digital.

El 60% de los sitios mejor posicionados en la búsqueda analizada fallaron en el aspecto más básico: ser técnicamente legibles. Esto no solo afecta la experiencia de usuario, sino que invalida cualquier intento de optimización para LLMs, AI Overviews o motores de respuesta generativa.

El Mínimo SEO Viable, en este contexto, ya no es una recomendación técnica. Es un umbral de existencia digital.

No es un paso más del checklist. Es la única manera de aparecer.

Los LLMs no te ignoran. Simplemente nunca pudieron leerte.

Hay algo profundamente ingenuo (y al mismo tiempo peligrosamente extendido) en la forma en que muchas marcas, agencias e incluso expertos SEO entienden la relación entre su sitio web y la inteligencia artificial. Se ha instalado una especie de fe ciega, casi supersticiosa, que dicta que basta con tener “buen contenido” para ser considerado por los modelos de lenguaje. Como si publicar un artículo en WordPress bastara para ser citado por ChatGPT, Gemini o Claude. Como si la existencia digital garantizara automáticamente la visibilidad semántica.

Pero los LLMs no funcionan así. No tienen memoria mística ni sensores ontológicos. Lo que tienen es acceso. Acceso a representaciones vectoriales de textos que pudieron procesar, almacenar, clasificar y comparar. Si tu contenido no puede ser accedido (ya sea por estar mal renderizado, por depender de scripts asincrónicos, por bloquear navegadores automatizados o por simplemente no entregar HTML útil al primer request) entonces no será parte del corpus que estructura el conocimiento del modelo. No habrá citación, no habrá mención, no habrá referencia. Ni siquiera como ejemplo negativo.

El problema no es la IA. El problema es que ni siquiera lograste entrar en su radar.

Y no, no importa cuán profundo sea tu análisis, ni cuán optimizadas estén tus entidades, ni cuántas veces hayas usado Schema.org con precisión quirúrgica. Si tu sitio no puede ser leído de forma funcional por los sistemas que hoy median la visibilidad digital (crawlers, indexadores, browsers sin sesión ni cookies, agentes vectoriales) entonces no existe. No estás excluido por falta de calidad, sino por ausencia estructural. Por no haber pasado la primera puerta: la del acceso técnico básico.

Epistemología vectorial: la IA no representa lo verdadero, representa lo accesible.

Los modelos de lenguaje no distinguen entre verdad y error. Distinguen entre patrones. Lo que aparece en sus respuestas no es lo más correcto, sino lo más visible dentro del conjunto de datos que pudieron procesar. Y ese conjunto de datos no es un reflejo puro de la realidad, sino un reflejo filtrado por condiciones técnicas previas. La principal: que el contenido haya podido ser leído.

Esto significa que el primer paso para formar parte del “conocimiento común” de la IA no es crear contenido brillante, ni siquiera contenido correcto. Es crear contenido accesible, rastreable, representable. La representación vectorial de una idea no se construye por méritos editoriales: se construye por frecuencia, contexto y legibilidad técnica.

Y esto cambia radicalmente el juego del SEO. Porque ya no se trata solo de convencer a Google, sino de construir una identidad semántica coherente, distribuida, reforzada y estructuralmente legible para los sistemas que ahora escriben la realidad en nombre de los humanos.

La idea de que “si mi contenido es bueno, me citarán” es falsa. La cita no ocurre si tu sitio falla en cargar. El reconocimiento no llega si tu HTML está vacío. El recuerdo no existe si la máquina nunca te pudo ver.

No estás fuera del juego por falta de relevancia. Estás fuera por haber confundido apariencia con existencia.

El Mínimo SEO Viable ya no es una optimización. Es un umbral de existencia.

Durante años, hablar de SEO técnico era hablar de crawl budget, velocidad de carga, redirecciones, estructura de encabezados y otros elementos que (aunque necesarios) parecían reservados para quienes ya tenían resuelto todo lo demás. Era una etapa “inicial”, sí, pero muchas veces subestimada. El contenido era el rey. El linkbuilding, la joya del poder. Lo técnico, una especie de trámite estructural.

Pero eso ya no funciona. Y no porque lo técnico haya ganado importancia, sino porque el contexto ha cambiado radicalmente. Hoy, la puerta de entrada a la web no es el navegador humano. Es el modelo de lenguaje. Y ese modelo no interpreta, no negocia, no intenta entenderte. Te representa si puede leerte. Y punto.

En este nuevo paradigma, el Mínimo SEO Viable no es solo una base: es un filtro ontológico. Es la diferencia entre ser parte del corpus representado o quedar fuera del campo semántico. No estás mejor posicionado por tenerlo: simplemente existes para los sistemas que ahora importan.

No se trata de si tu sitio es más rápido que el de la competencia, sino de si siquiera puede ser cargado en un entorno sin navegador gráfico. No importa si tus títulos son perfectos, si el modelo nunca llegó a leerlos. Y no sirve de nada invertir en prompts optimizados si, cuando el modelo intenta buscarte, choca con una pared de JavaScript o una validación de sesión.

El MSV, en este nuevo escenario, no es una práctica recomendada. Es una condición de posibilidad. Es lo mínimo necesario para no desaparecer del mapa cognitivo de las máquinas que están reescribiendo lo que el mundo cree saber.

Quieren optimizar para los LLMs, pero no han logrado ni aparecer en ellos

En 2025, todo el mundo quiere “estar” en las respuestas generadas por IA. Es la nueva fiebre del oro. Los consultores fabrican checklists de prompts, las agencias rediseñan su discurso, los gurús prometen frameworks para dominar los LLMs como si fueran oráculos. El problema no es la ambición. El problema es el olvido estructural: la mayoría de esos sitios ni siquiera puede ser leído.

Es absurdo, pero ocurre todos los días: marcas que destinan recursos a entender cómo “entrenar a los modelos”, pero que no han verificado si su contenido se entrega correctamente sin JavaScript. Agencias que ofrecen servicios de optimización para AI Overviews sin saber que el sitio de su cliente devuelve un 403 a cualquier intento de scraping legítimo. Especialistas en SEO semántico que no pueden acceder a sus propias páginas desde un navegador sin abrir una sesión.

Están diseñando para la mente de la máquina sin saber si su cuerpo es visible.

Este nivel de disonancia operativa no es casual. Es el resultado de años de haber entendido el SEO como una serie de hacks narrativos, de haber despreciado la infraestructura, de haber privilegiado la apariencia sobre la existencia técnica. Y ahora que el juego ha cambiado (ahora que la visibilidad ya no depende solo del ranking en Google, sino de la inclusión en modelos que se entrenan con fuentes rastreables) esa ceguera se vuelve letal.

Porque los LLMs no tienen intención de encontrarte. No te están buscando activamente. Solo recuerdan lo que alguna vez fue visible. Lo que fue citado, indexado, procesado, enlazado. Lo que fue abierto sin errores. Lo que pudo entrar en su corpus.

Todo lo demás (todo lo que tú crees que sabes, que ofreces, que aportas) simplemente no existe.

El SEO no está muerto. Lo que está muerto es tu acceso.

La muerte del SEO ha sido anunciada tantas veces que ya suena como una estrategia de contenido más. Con cada cambio de algoritmo, con cada nueva sigla de Google, con cada irrupción tecnológica, surge un coro de obituarios apresurados. Pero nunca han sido verdad. Y esta vez tampoco lo es.

Lo que sí está muerto (y nadie se atreve a decirlo) es tu capacidad de aparecer. Porque mientras tú culpas al algoritmo, a la IA, al tráfico perdido, al fin de las cookies, hay algo mucho más básico que está fallando: tu sitio no se puede leer. No es que no aparezcas en los LLMs porque no has sido citado. Es que no has sido ni siquiera visto.

El SEO, hoy más que nunca, no es opcional. Es fundamental. Porque no se trata solo de posicionarse: se trata de existir en un ecosistema donde las máquinas reconstruyen el mundo a partir de lo que pueden representar. Y para ser representado, primero hay que ser accesible. No retóricamente. Técnicamente.

El Mínimo SEO Viable ya no es una cuestión de performance. Es una cuestión de ontología digital.

Si tus headers están bien estructurados, pero tu HTML no se entrega, no existes.

Si tus entidades están conectadas, pero el crawler nunca termina de cargar la página, no existes.

Si invertiste en prompts, fine-tuning y taxonomías, pero tu sitio devuelve un error 403, no existes.

Aparecer en Google ya no es suficiente.

Hoy, el reto es ser legible, accesible, citable.

Porque para los modelos que deciden lo que el mundo ve… lo que no pueden leer, no existe.